Un nuovo paradigma, affacciatosi recentemente sul panorama tecnologico delle architetture di rete, si pone come obiettivo quello di ampliare le caratteristiche del Cloud, rendendo il modello che ne consegue particolarmente adatto all’esecuzione dei servizi e delle applicazioni dagli elevati requisiti.

Spostare le risorse in un punto della rete più vicino alla produzione dei dati è la soluzione che questo paradigma propone per sopperire alle elevate latenze che impediscono l’esecuzione di applicazioni che richiedono tempistiche vicine al real -time e che generano un alto traffico di dati.

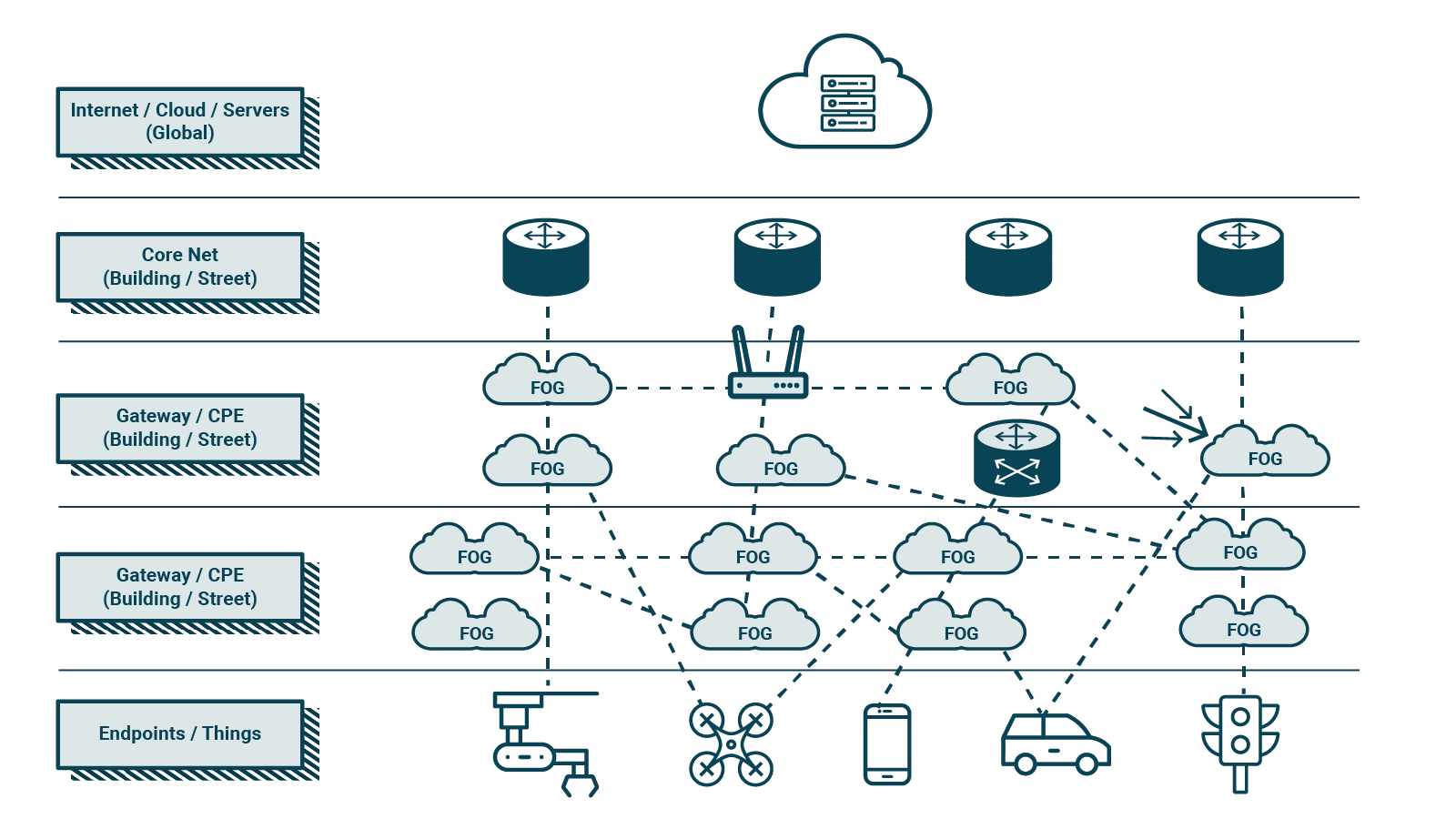

Il modello Fog/Edge Computing a tre livelli inserisce delle risorse utilizzabili sull’edge della rete, come succede per le risorse rese disponibili dal Cloud nella core network. I vantaggi derivanti dall’adozione di un siffatto modello comprendono una bassa latenza, il supporto alla mobilità, e la possibilità di estrarre e usare informazioni contestuali agli utenti. Parte dell’infrastruttura presente sull’edge, dedicata allo svolgimento dei servizi, si appoggia al Cloud per le computazioni complesse e per il backup dello stato pesante del sistema. Il modello risultante è il tassello abilitante che permetterà alle infrastrutture esistenti di adempiere alle richieste delle moderne applicazioni, soprattutto relative all’IoT, che necessitano di processare i dati vicino alla sorgente per minimizzare la latenza ed evitare frequenti connessioni con il Cloud, contenendo così anche il traffico di rete generato. Le centraline di collegamento wireless potranno esse stesse ospitare le risorse necessarie alle continue micro operazioni prima demandate al Cloud, di modo da poter fornire una bassa latenza a tutte quelle applicazioni che hanno bisogno di un responso real-time circa l’analisi della grossa mole di dati che collezionano e inviano in rete.

Le motivazioni che hanno mosso le aziende verso l’adozione del paradigma di Edge Computing sono molteplici:

- Velocità: l’Edge Computing rende de facto possibile l’unica architettura IT che consente di far comunicare più dispositivi scambiando i dati in tempo reale. La riduzione della latenza nelle operazioni sarebbe impossibile con il semplice ricorso al cloud computing, soprattutto nell’ambito delle applicazioni mobile. La condizione da privilegiare per sfruttare appieno le logiche Big Data & Analytics, come vedremo, deriva infatti dal saper combinare in maniera efficace i punti di forza del cloud e dell’edge in una soluzione di continuità funzionale.

- Scalabilità: l’Edge Computing consente di svincolarsi dalle risorse centralizzate per le operazioni in prossimità dei dati, il che si riflette in una maggior agilità di configurazione dei sistemi IoT, la cui espansione non è più vincolata esclusivamente alla scalabilità delle risorse in cloud, ma è resa possibile grazie al semplice aumento dei dispositivi informatici e dei micro data center collocati ai margini della rete. Grazie all’edge computing si ottiene dunque un doppio livello di scalabilità delle risorse, sia a livello locale che in cloud. L’onere più rilevante è costituito dalle competenze necessarie per configurare un’architettura cloud-to-edge capace di bilanciare in maniera ottimale la richiesta computazionale necessaria ai vari livelli funzionali del sistema.

- Resilienza: L’Edge Computing riduce la quantità di dati proveniente dalla rete primaria, privilegiando la disponibilità dei dati ai margini della rete. Questo modello di gestione del dato rende la pipeline di lavoro meno soggetta a rischi di down di un data center in cloud, in quanto il dato utile a livello operativo risulta disponibile sul device stesso, piuttosto che su un micro data center locale. In altri termini, per garantire la resilienza di un sistema basato sull’edge computing è sufficiente prevedere una condizione di sincronia periodica tra i dati in locale e i data storage in cloud, che possono essere aggiornati con una frequenza decisamente inferiore rispetto a quella necessaria a livello operativo.

- Sicurezza: per certi aspetti potrebbe sembrare un paradosso, in quanto il design di un’architettura edge aumenta a dismisura i punti di vulnerabilità di un sistema, per via della pluralità dei nodi e dei gateway che corrispondono ai vari punti di accesso violabili da un attacco proveniente dalla rete. Tale condizione, se opportunamente sfruttata, costituisce al tempo stesso una notevole risorsa per gli esperti di cyber security, che possono isolare le varie zone della rete per neutralizzarle in caso di episodi malevoli. I protocolli di sicurezza possono infatti attivarsi per isolare i vari elementi che compongono l’intero sistema: dal singolo terminale ad interi comparti funzionali